gpu编译

探索GPU语言编程:加速计算的利器

在当今信息时代,大数据和复杂计算已经成为许多行业的日常。为了处理这些数据量庞大、计算复杂的任务,传统的中央处理器(CPU)已经显得力不从心。因此,图形处理器(GPU)的应用变得越来越广泛。GPU语言编程作为一种加速计算的利器,正受到越来越多开发者的关注和应用。

1. 什么是GPU语言编程?

GPU语言编程是指利用图形处理器进行通用目的计算(GPGPU)的编程过程。传统上,GPU主要用于图形渲染,但是由于其并行处理能力强大,现在已经被广泛用于加速各种计算任务,如科学计算、深度学习、密码学等。

2. 主流的GPU语言

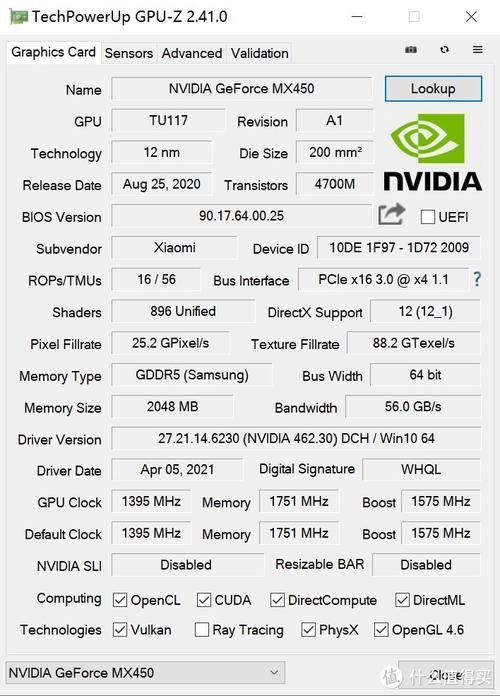

2.1 CUDA(Compute Unified Device Architecture)

CUDA是由NVIDIA推出的一种针对NVIDIA GPU的并行计算平台和编程模型。它提供了丰富的库函数和工具,使开发者能够充分利用GPU的并行计算能力。

2.2 OpenCL(Open Computing Language)

OpenCL是一种开放标准的并行计算框架,它可以用于多种硬件平台,包括GPU、CPU、FPGA等。相比CUDA,OpenCL更具有跨平台的优势,但相对而言编程门槛稍高。

2.3 Vulkan

Vulkan是一种图形和计算API,也可以用于GPU加速计算。它与OpenGL相比具有更低的驱动开销和更好的多线程支持,适用于高性能计算和游戏开发等领域。

3. GPU语言编程的优势

3.1 并行计算能力

GPU拥有数千个核心,能够同时处理大量数据,比传统的CPU具有更强的并行计算能力。这使得GPU在处理大规模数据和复杂计算任务时表现出色。

3.2 加速计算速度

由于其并行计算的特性,GPU可以大幅提高计算速度。许多任务在GPU上的运行速度可以比在CPU上快几个数量级,极大地提高了计算效率。

3.3 应用广泛

GPU语言编程不仅适用于科学计算领域,还可以用于深度学习、密码学、图像处理、物理模拟等各种领域。它已经成为许多行业加速计算的重要工具。

4. GPU语言编程的挑战

4.1 学习曲线陡峭

相比传统的CPU编程,GPU语言编程有较高的学习门槛。开发者需要理解并行计算的概念,掌握特定的编程模型和语法,这对于初学者来说可能会有一定的挑战。

4.2 内存管理复杂

GPU的内存架构与CPU不同,开发者需要仔细管理GPU内存的分配和释放,以避免出现内存泄漏或访问冲突等问题,这增加了编程的复杂性。

5. GPU语言编程的指导建议

5.1 深入学习并行计算原理

在开始GPU语言编程之前,建议开发者深入学习并行计算的基本原理,包括线程、块、网格等概念,这有助于更好地理解GPU编程模型。

5.2 利用现有资源和工具

针对不同的GPU语言,有许多优秀的教程、文档和示例代码可供参考。开发者可以利用这些资源快速入门,并通过实践不断提升自己的编程技能。

5.3 注意性能优化和调试

在进行GPU语言编程时,性能优化和调试是非常重要的环节。开发者应该注意代码的并行化程度、内存访问模式等因素,以提高计算效率并避免常见的错误。

结论

GPU语言编程作为一种加速计算的利器,正在被越来越多的开发者所采用。虽然存在一些挑战,但通过深入学习并不断实践,开发者可以充分发挥GPU的潜力,加速各种计算任务的处理速度,从而为科学研究、工程应用和商业领域带来更大的价值。